Nutzt du KI für deine Inhalte? Dann musst du aufpassen. Denn seit dem EU AI Act gibt es klare Regeln für die Kennzeichnung von KI-Inhalten.

Texte, Bilder und mittlerweile sogar Videos, Musik oder Podcasts werden immer häufiger ganz oder teilweise mit KI erstellt. Und das nicht immer mit guter Absicht. Deepfakes etwa können ernsthaften politischen oder persönlichen Schaden verursachen.

Entsprechend wird in Politik und Wirtschaft schon länger über eine Kennzeichnungspflicht von KI-Inhalten diskutiert.

Doch was ist der aktuelle Stand? Gibt es bereits eine Kennzeichnungspflicht? Und wenn ja, ab wann und wie genau müssen KI-Inhalte gekennzeichnet werden?

In diesem Artikel erfährst du alles, was du dazu wissen musst. Ich gehe dabei auf alle drei Instanzen (national, EU-weit und Technologiekonzerne), die eine Kennzeichnungspflicht von Endnutzern oder Technologiekonzernen verlangen könnten, ein.

- Seit Mai 2025 gilt eine Kennzeichnungspflicht für KI-generierte Inhalte laut EU AI Act. Verstöße kosten bis zu 15 Mio. € oder 3 % des Jahresumsatzes.

- Nationale deutsche Gesetze existieren noch nicht, aber Plattformen wie YouTube und Meta haben bereits eigene Kennzeichnungspflichten eingeführt

- Kennzeichnung muss "klar und deutlich" erfolgen. Bei Deepfakes und öffentlich relevanten Themen besteht absolute Kennzeichnungspflicht.

1. Nationale Kennzeichnungspflicht

In Deutschland gibt es aktuell keine nationalen Richtlinien oder Gesetze, die die Kennzeichnung von KI-generierten Inhalten vorschreiben.

Eine Kennzeichnungspflicht wird jedoch schon seit längerem diskutiert. So hat die Linksfraktion z. B. Mitte Juni 2023 im Bundestag in einem Antrag eine Kennzeichnungspflicht beim Einsatz von KI-Systemen für die Generierung von Inhalten, „die öffentlich zugänglich gemacht werden oder nicht rein privater Natur sind“ gefordert. Dieser Antrag wurde jedoch im November 2023 abgelehnt.

Auch der Bundesbeauftragte für den Datenschutz (BfDI) betont in einer Stellungnahme ebenfalls die Wichtigkeit der Kennzeichnung von KI-Inhalten als Schutzmechanismus für Verbraucher, insbesondere im Kontext von Propaganda und rufschädigenden Inhalten

Dazu kommt, dass bestehende Regelungen zum Verbraucherschutz, Persönlichkeits- oder Wettbewerbsrecht möglicherweise dennoch Anwendung finden könnten.

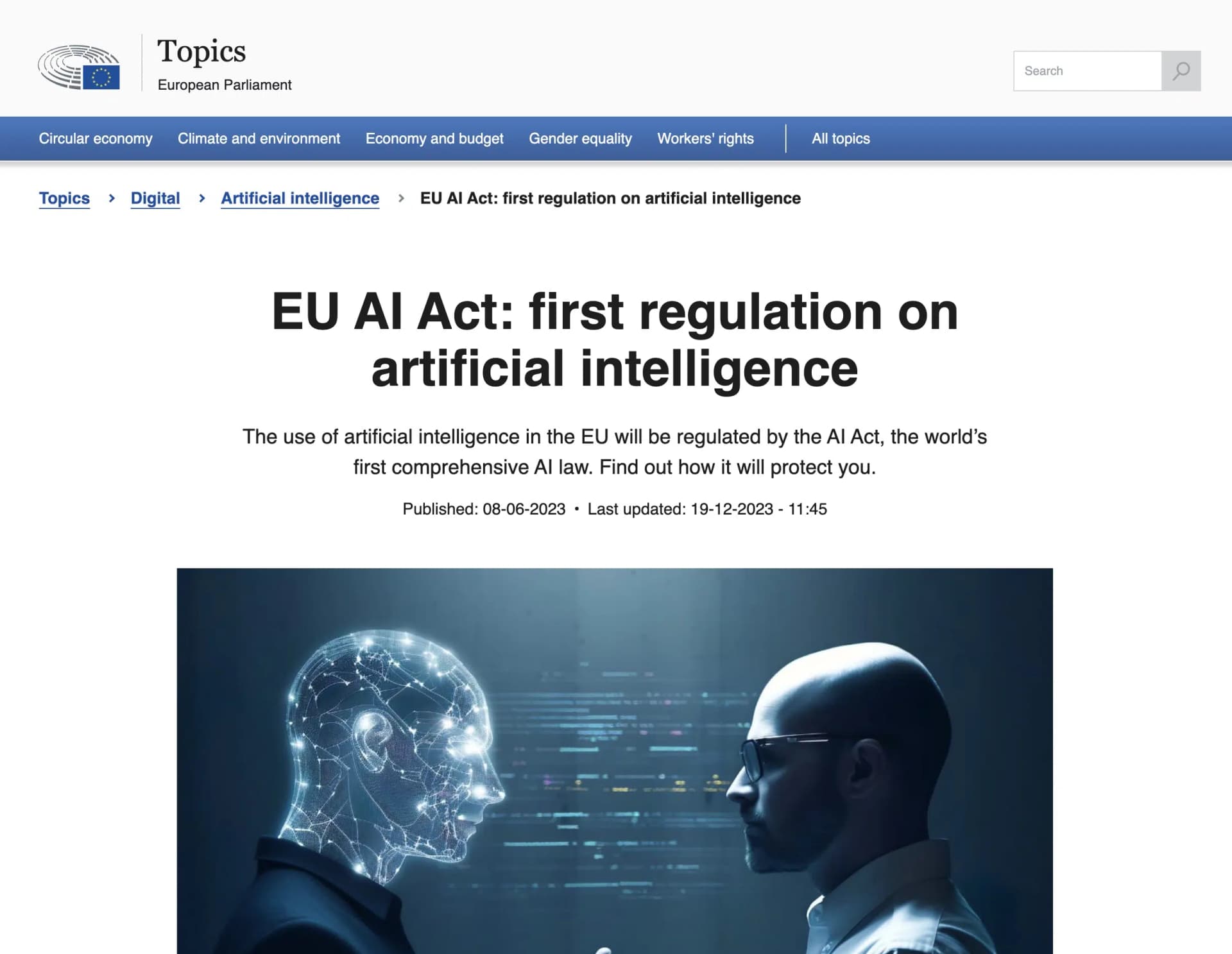

2. EU AI Act

Die EU hat mit dem Artificial Intelligence Act im März 2024 eine Richtlinie auf den Weg gebracht, um EU-weit Regularien für KI-Systeme gesetzlich zu verankern.

Er sieht in Artikel 50 auch Transparenzpflichten für Anbieter und Nutzer bestimmter KI-Systeme und -Tools vor.

- Anbieter von KI-Tools, die Audio-, Bild-, Video- oder Textinhalte erzeugen, müssen sicherstellen, dass die Ausgaben der Tools in einem maschinenlesbaren Format als künstlich erzeugt oder manipuliert gekennzeichnet sind.

- Nutzer von KI-Bildgeneratoren, KI-Sprachgeneratoren, KI-Musikgeneratoren oder KI-Videogeneratoren müssen offenlegen, wenn sie Deepfakes (täuschend echt wirkende KI-generierte Bild-, Audio- oder Videoinhalte von Personen, Orten oder Ereignissen) veröffentlichen.

- Nutzer müssen auch KI-Texten zu Themen von öffentlichem Interesse kennzeichnen, dass diese künstlich erzeugt wurden. Eine Ausnahme gilt, wenn der Text von Menschen überprüft und redaktionell bearbeitet wurde.

In den Erwägungsgründen 132-136 wird die Notwendigkeit der Kennzeichnung von KI-generierten Inhalten näher erläutert.

Es wird betont, dass Nutzer in der Lage sein müssen, KI-generierte Inhalte, die zunehmend schwerer von menschengemachten Inhalten zu unterscheiden sind, zu erkennen. Die Kennzeichnungspflicht soll dem Risiko von Fehlinformation und Manipulation entgegenwirken.

Erwägungsgrund 134 stellt klar, dass die Kennzeichnungspflicht für Deepfakes die Meinungs- und Kunstfreiheit nicht beeinträchtigen soll. Bei erkennbar künstlerischen, satirischen oder fiktionalen Werken ist nur eine angemessene Offenlegung des KI-Einsatzes nötig, ohne das Werk selbst zu beeinträchtigen.

Die Kennzeichnungspflicht wird in Deutschland verbindlich, sobald die KI-Verordnung vollständig in nationales Recht umgesetzt wurde. Der EU AI Act ist seit August 2024 in Kraft und die Umsetzung in nationales Recht wird voraussichtlich bis Mitte 2026 abgeschlossen sein.

2.1 Wann kommt der EU AI Act?

Der Zeitplan für das Inkrafttreten des EU AI Act lässt sich wie folgt zusammenfassen:

- Am 13. März 2024 hat das Europäische Parlament dem AI Act zugestimmt und ihn damit formal verabschiedet.

- Am 21. Mai 2024 hat der EU-Rat dem Gesetz zugestimmt. Details können der Pressemitteilung entnommen werden.

- 20 Tage nach der Veröffentlichung im Amtsblatt der EU tritt die Verordnung in Kraft.

- Die meisten Regelungen des AI Act gelten dann 24 Monate nach Inkrafttreten, also voraussichtlich ab Mitte 2026.

Einige Bestimmungen haben aber kürzere Übergangsfristen.

- Verbote besonders riskanter KI-Systeme gelten schon nach 6 Monaten

- Regeln für generative KI gelten nach 12 Monaten

- Verpflichtungen für „eingebettete KI-Systeme“ erst nach 36 Monaten

Das heißt, der EU AI Act trat im August 2024 in Kraft, die meisten Regelungen gelten aber erst ab Mitte 2026. Einige besonders wichtige Bestimmungen wie Verbote hochriskanter Systeme griffen schon deutlich früher.

2.2 Wie müssen KI-Inhalt laut EU AI Act gekennzeichnet werden?

Der EU AI Act enthält keine konkreten Vorgaben, wie genau die Kennzeichnung von KI-generierten Inhalten erfolgen muss.

Der AI Act schreibt lediglich vor, dass KI-generierte Inhalte wie Texte, Bilder, Audio und Video „eindeutig“ als solche gekennzeichnet werden müssen. Nutzer sollen klar erkennen können, wenn Inhalte maschinell erzeugt wurden.

Insbesondere bei Marketingaktivitäten, die KI-Inhalte verwenden, muss eindeutig offengelegt werden, dass es sich um KI-Erzeugnisse handelt.

Auch bei der Veröffentlichung von KI-generierten Texten, die die Öffentlichkeit über wichtige Themen informieren sollen, muss transparent gemacht werden, dass die Texte künstlich erstellt wurden.

Wie diese Transparenz und Kennzeichnung aber konkret umzusetzen ist, z. B. durch Disclaimertexte, Wasserzeichen auf Bildern, Hinweise in Metadaten etc. lässt der AI Act offen.

Die genaue Ausgestaltung der Kennzeichnungspflicht wird wohl erneut den Anbietern und Nutzern von KI-Systemen überlassen, womit rechtliche Klarheit erst durch etliche Gerichtsurteile erreicht werden wird (ähnlich wie bei der DSGVO).

2.3 Welche Konsequenzen drohen bei Verstößen gegen die Kennzeichnungspflicht?

Unternehmen, die gegen die Kennzeichnungspflicht für KI-generierte Inhalte gemäß dem EU AI Act verstoßen, könnten folgende Konsequenzen drohen:

1. Hohe Geldstrafen

Für Verstöße gegen die Pflichten aus dem AI Act, wie z. B. die Kennzeichnungspflicht, können Geldbußen von bis zu 15 Millionen Euro oder 3 % des weltweiten Jahresumsatzes verhängt werden, je nachdem, welcher Betrag höher ist.

Für kleine und mittelständische Unternehmen sowie Start-ups sollen allerdings geringere Obergrenzen gelten.

2. Verbot des KI-Systems

Anbieter können gezwungen werden, ihre KI-Systeme vom Markt zu nehmen, wenn sie wiederholt oder schwerwiegend gegen die Vorschriften verstoßen.

3. Wettbewerbsrechtliche Konsequenzen

Neben Geldstrafen im Rahmen des EU AI Acts können auch wettbewerbliche Konsequenzen drohen, z. B. Abmahnungen.

3. Kennzeichnung bei großen Online-Plattformen

Einige große Online-Plattformen und soziale Netzwerke haben schon freiwillig und vor der Einführung des EU AI Acts eine Kennzeichnungspflicht für Creator eingeführt und/oder kennzeichnen KI-Inhalte automatisch. Hier ein kleiner Überblick.

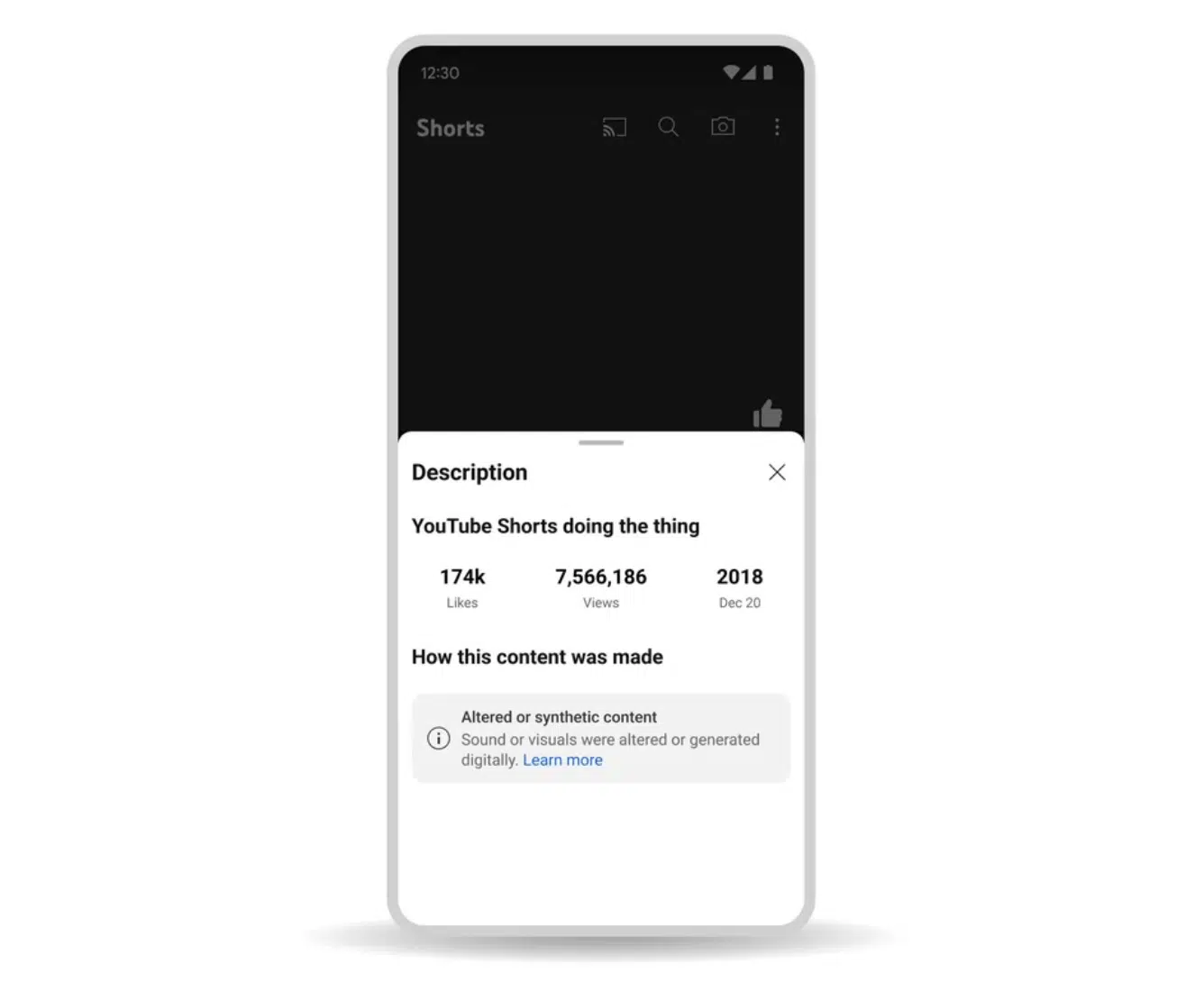

3.1 YouTube

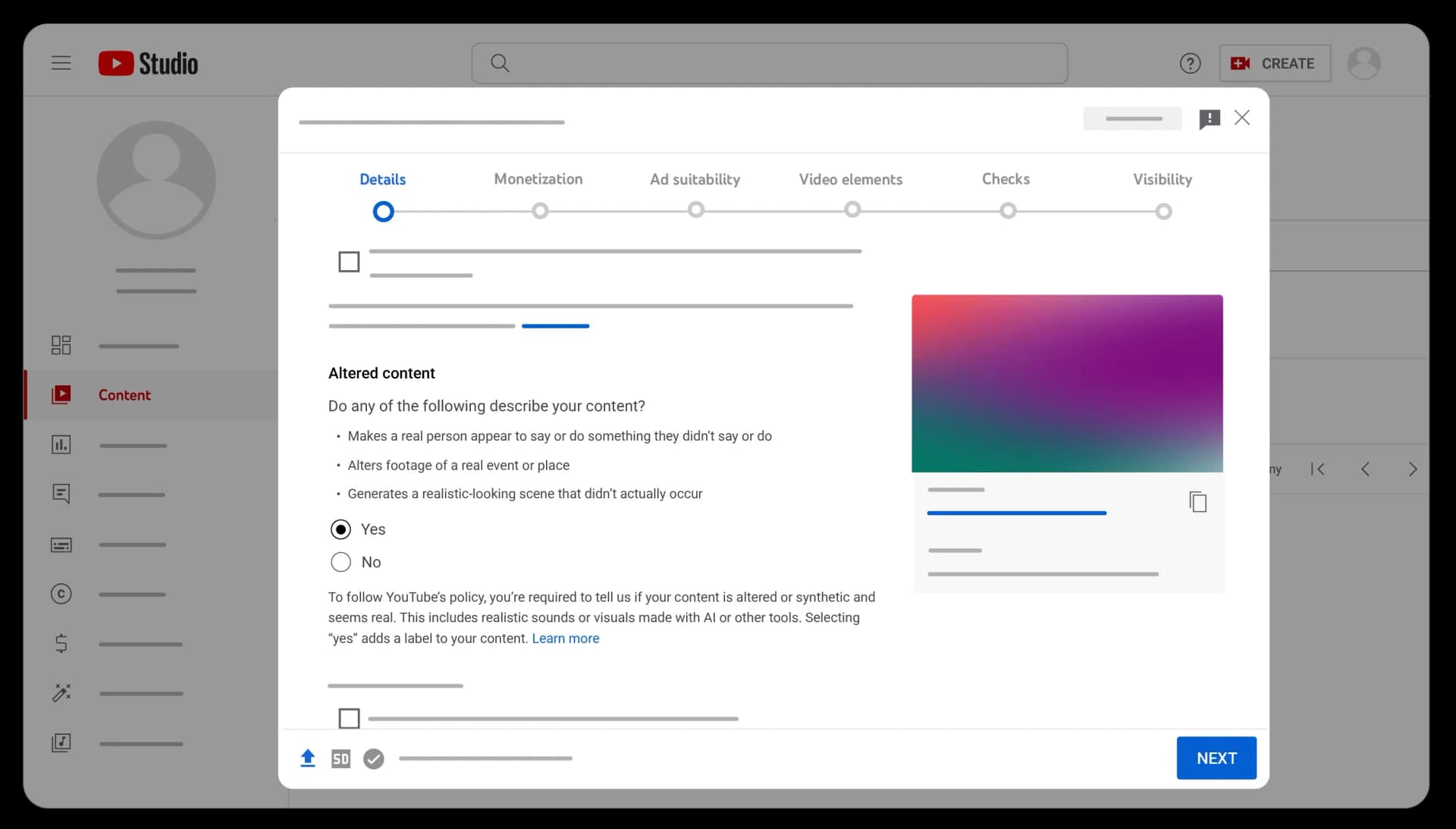

Seit November 2023 müssen Creator beim Hochladen von YouTube-Videos angeben, ob diese KI-generierte Inhalte enthalten, die echt wirken könnten.

Die Kennzeichnung erfolgt über eine Option im YouTube Studio, die „Altered content“ (veränderte Inhalte) heißt.

Die Kennzeichnung wird in der Videobeschreibung angezeigt.

Bei sensiblen Themen wie Nachrichten oder Wahlen blendet YouTube den Hinweis direkt im Video ein.

Verstöße können laut YouTube-Hilfe zur Entfernung der Videos, zum Ausschluss vom Partnerprogramm führen oder dafür sorgen, dass eine permanente Kennzeichnung in Videos angezeigt wird, die seitens der Creator nicht entfernt werden kann.

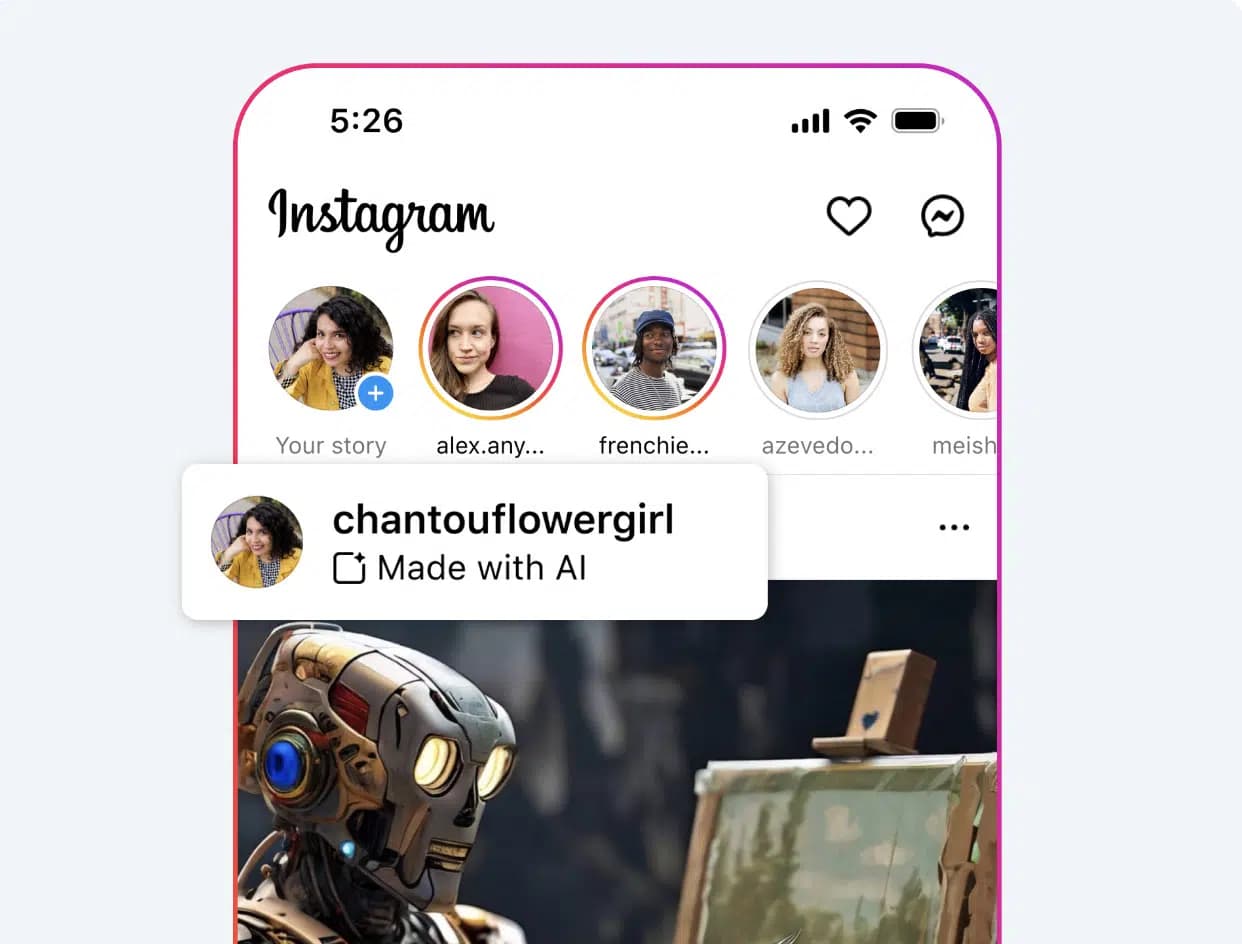

3.2 Meta (Facebook, Instagram, Threads)

Meta hat angekündigt, ab Mai 2024 eine breitere Palette von KI-generierten Inhalten wie Videos, Audios und Bildern mit der Kennzeichnung „Made with AI“ zu kennzeichnen.

Diese Änderungen basieren auf Empfehlungen des Oversight Boards sowie umfangreichen Konsultationen mit Experten und öffentlichen Meinungsumfragen.

Ziel ist es, mehr Transparenz und Kontext für Nutzer zu schaffen, anstatt solche Inhalte einfach zu entfernen und damit möglicherweise die Meinungsfreiheit einzuschränken.

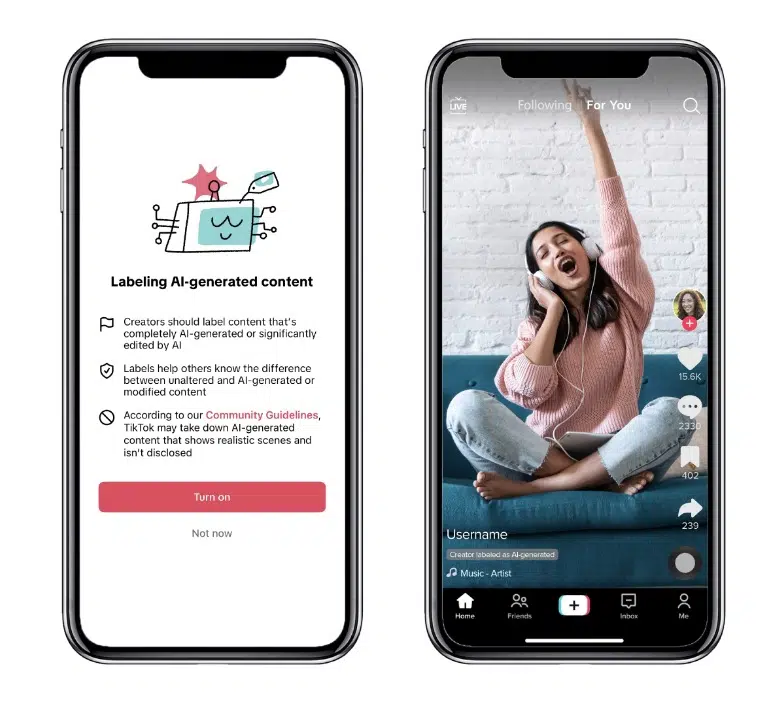

3.3 TikTok

TikTok hat im September 2023 ein neues Tool eingeführt, mit dem Creator ihre KI-generierten Inhalte kennzeichnen können.

Ziel davon ist, Transparenz zu schaffen und die TikTok-Nutzer darüber zu informieren, wenn Inhalte mit KI erstellt oder bearbeitet wurden.

Laut Pressemitteilung testet das Unternehmen auch automatische Kennzeichnungen für KI-generierte Inhalte und arbeitet mit Experten zusammen, um effektive Kennzeichnungsrichtlinien zu entwickeln und die besten Praktiken der Branche für Transparenz und verantwortungsvolle Innovation im Bereich der KI umzusetzen.

3.4 Twitter/X

Bei X (ehemals Twitter) gibt es bislang keine konkreten Handlungsempfehlungen, Richtlinien oder Pflichten, KI-generierte Inhalte zu kennzeichnen.